こんにちは、DX攻略部のkanoです。

日々の業務の中で、膨大なデータを取り扱うことはコストや時間がかかります。

そういった問題を解決するためにおすすめなのが「ETLツール」というツールです。

ETLツールを活用することで得られるコスト削減や効率化について解説していきます。

なぜ今「ETLツール」が注目されるのか?

最初になぜ今「ETLツールが注目されているのか」という点について解説します。

ETLツールが注目されている理由を理解すれば、自社の業務においてETLツールを導入する必要性が見えてくることでしょう。

データ活用が進む中で浮上する課題

近年、ビジネスの場ではあらゆる意思決定にデータを活用する動きが加速しています。

そのため、企業が蓄積するデータ量は膨大なものとなっており、データの出所も多岐にわたっている状態です。

- データソースの分散化

- データの増加速度

- 分析ニーズの高度化

データソースとして、SaaSツール、広告プラットフォーム、クラウドストレージなどがバラバラに存在している企業は珍しくありません。

こういった異なる形式や構造のデータがあり、取り扱いが課題になっているわけです。

また、リアルタイムかつ膨大なデータが蓄積され続け、データの増加速度に頭を悩ませているケースもあります。

そして、せっかく集めたデータを分析したいと考えても、フォーマットが統一されていない、欠損や重複データが多い、という問題もあるでしょう。

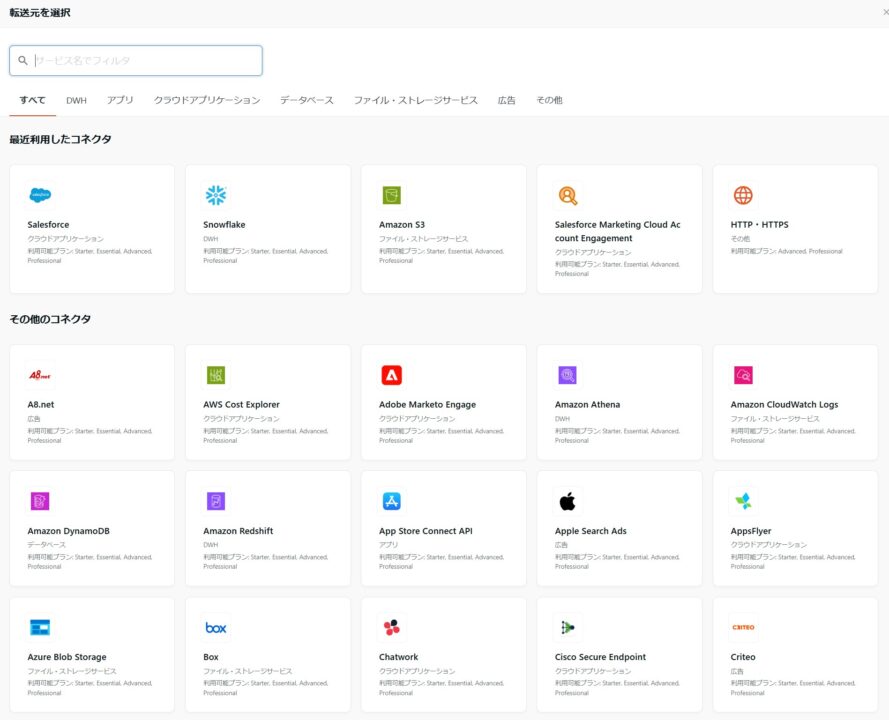

こういった問題を解決するために、ETLツールが持つ、「データを抽出する」、「変換する」、「ロードする」という機能が注目を集めています。

※ETLツール「TROCCO」のデータ転送元の一部を抜粋した場面

ETLツールは、データを一元管理する仕組みと、変換・統合を効率的におこなってくれるため、データを効率的に活用できるようになるのです。

こんにちは、DX攻略部のkanoです。 TROCCOはデータ基盤の総合支援サービスとして注目を集めているツールです。 しかし、私のような非エンジニアでもデータ転送や連携は難しくないのか気になっていました。 そのため、最初に[…]

手作業やスクリプト運用に潜むコスト増大のリスク

この記事を読んでいるあなたの企業では、データをどのように処理していますか?

Excelや独自のスクリプトでデータを整理・統合しているのではないでしょうか?

もちろん、そのやり方が間違っているわけではありませんが、データが膨大になってくると、様々なリスクが発生します。

- 人的リソースの圧迫

- ヒューマンエラー

- スケーラビリティの欠如

- 運用コストの不透明化

手動でデータ転送や変換をおこなう場合、大きな問題となるのが人的リソースの圧迫です。

日常業務として多くの時間が取られてしまい、他の業務がおざなりになることも珍しくありません。

また、担当者が不在な場合や退職した場合に、そのノウハウを引き継ぐことが難しい、というケースもあります。

その他にも、スクリプト修正時のミスなどヒューマンエラーを経験した企業も多いでしょう。

データ量が増加して分析のタイミングが遅れることや、新たなデータソースを取り込むたびにスクリプトの改修が必要になるなど、スケーラビリティの欠如の問題も課題といえます。

これらの問題を解消できない状態が続くと、想定しているよりも工数や費用がかかっていたという、運用コストの不透明化につながることも重要な課題です。

手作業やスクリプト運用に潜むコスト増大のリスクを解決する方法として、ETLツールが注目されるようなりました。

ETLツールがもたらす効率化の可能性

では、ETLツールを導入することでどういった効率化が望めるのでしょうか?

- 作業時間の大幅な削減

- データ品質の向上

- スケーラビリティとコスト管理

- 分析・可視化へのスムーズな連携

データを活用する上で抱えている課題やリスクは、ETLツールを導入することで大きく改善できます。

ETLツールを導入すれば、毎日のデータ転送や変換がボタンひとつでスケジュール設定可能になり、自動で処理してくれます。

データ転送や変換が自動化されることで、その業務に携わっていた担当者は分析やその他の業務に時間を使えるようになるのです。

ETLツールを使い、安定したデータパイプラインを構築すれば、データ品質は向上します。

データ量の増加に合わせて自動的にスケールアップ・ダウンさせる機能を備えているETLツールも多く、スケーラビリティとコスト管理もしやすくなるでしょう。

ETLツールはデータウェアハウス(DWH)やBIツールとの連携が簡単であり、分析や可視化へのスムーズな連携を可能にしてくれます。

このように、「データはあるが有効活用できていない」、「定型作業が多すぎて他業務に支障が出ている」という企業がETLツールに注目するようになったのです。

コスト削減の実例:ETLツール導入前後で何が変わった?

ETLツール導入前後で生じる変化を3つのポイントに分けて解説します。

人的リソースの削減と作業時間の短縮

ETLツールを導入することで、下記のような人的リソースと作業時間の問題が解決します。

| 導入前 | 導入後 |

| 手作業でジョブを実行 | ワークフローの自動スケジューリングで、日々のジョブ実行がボタンひとつまたは時間設定で完結 |

| 複数のスクリプトをメンテナンスし、エラー修正やロジック変更に時間がかかっていた | 標準機能であるエラー検知・リトライ処理で、人的チェック頻度の大幅な減少 |

| 担当者が祝日・深夜につきっきりで対応していた | データの取得・変換・ロードをツールが管理してくれるので、担当者はコア業務や分析にリソースを集中できる |

ETLツールを導入すると、上記のように改善できるため、「以前は1日数時間かけていた定型作業が、ほぼゼロになった」と感じるようになります。

また、データ担当者の工数を別業務に回せるようになる、というのも導入前と導入後の大きな変化といえるでしょう。

運用負荷の軽減と障害対応コストの低減

運用負荷と障害対応コストについては、どのような変化が起きるでしょうか?

| 導入前 | 導入後 |

| スクリプトが分散管理されており、障害が起こった際の原因特定に時間がかかっていた | ETLツールのダッシュボード上で、ジョブの実行履歴やエラー状況が一元管理できるので原因特定までがスムーズになった |

| ログ確認がバラバラの場所でおこなわれており、再現テストや修正作業が担当者任せだった | エラーが発生すると、メールやSlackで自動通知され、原因箇所のログがすぐに確認できるようになった |

| 属人化が進み、トラブル対応できる人が限られていた | 担当者が変わっても、GUIでワークフローを確認できるため、スムーズな引き継ぎが実現できた |

ETLツールを導入後は、障害対応にかかる時間や機会損失が大幅に減少するため、サービスの安定稼働や業務の円滑化につながります。

運用トラブルが減ることで、社員の生産性や士気向上につながり、間接的なコスト削減効果も期待できるのです。

ランニングコストの可視化

ETLツール導入前は、サーバー費用や開発工数の明確なコスト管理ができていないことが多いです。

通常、クラウドETLツールの場合はデータ転送量やコネクタ数に応じた料金形態が一般的なため、月々のランニングコストが明確になります。

また、メンテナンス工数が把握しやすくなることで、トラブル対応やスクリプト修正に割かれていた人件費、機会損失などの隠れコストが改善されるのもメリットです。

ETLツール導入前と後では、人的リソース、運用トラブル、ランニングコストで大きな成果が得られるでしょう。

ETLツール導入による効率化を実現するためのベストプラクティス

ETLツール導入による効率化を最大限発揮するためには、いくつかのポイントがあります。

どのような点に気をつければいいのか、ETLの運用効率化の秘訣を解説します。

自動化で押さえておくべきポイント

ETLツールはデータ業務の多くを自動化できるツールです。

しかし、自動化するうえではデータソースの一覧化やETLジョブの目的と範囲をきっちりと定義しておきましょう。

また、提示にジョブを実行する「タイムベース」にするか、ファイルがS3にアップロードされたら処理をおこなう「イベントベース」にするかも決めておきましょう。

データのロードを最適化するために、すべてのデータを取り込み直す「フルロード」にするか、更新部分のみ取り込む「増分ロード」にするかも検討材料です。

こういった、自動化の進め方についてきっちりと定義化することで、自動化の効率化がアップします。

エラー検知・リトライ設定のポイント

エラー検知では、ジョブが失敗した時点でメールやSlackに通知する「リアルタイム通知」が便利です。

また、ETLツールや外部のログ管理サービスで、一元的にログを閲覧できる「ログの集中管理」も必要になってくるでしょう。

リトライ回数は適切な回数や間隔に設定し、無駄な再実行や負荷を軽減する設定にしておくと、効率化につながります。

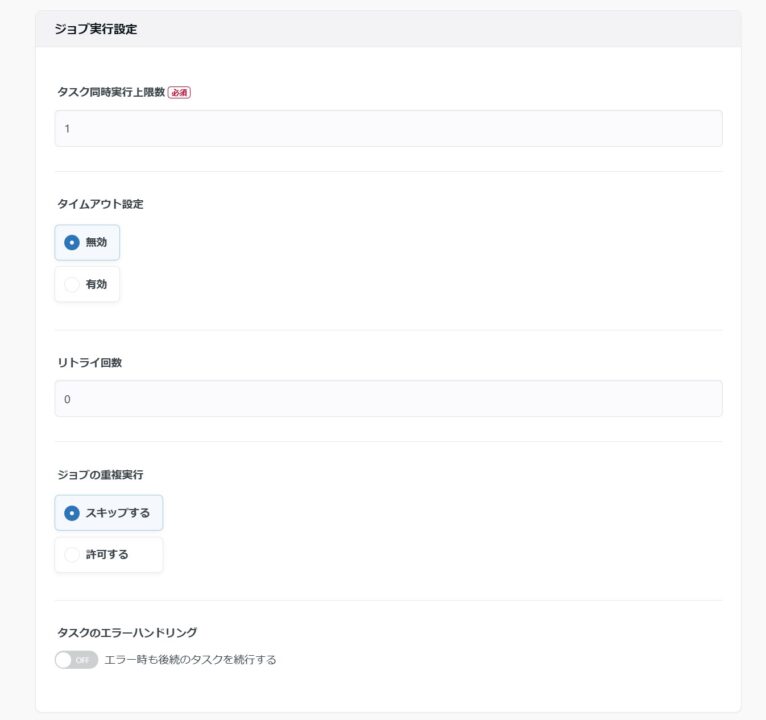

※ETLツール「TROCCO」のワークフロー設定画面でタイムアウト設定やリトライ回数を設定する画面

データ品質チェックでは、欠損値・重複データの検証のために変換処理の前後でデータレコード数が期待通りかを自動テスト設定にしておくと便利です。

エラー検知やリトライ設定を適切にすることで、ETLツールの効率化がさらに進みます。

ETLツール選定時に気をつけたいポイント

では、ETLツールを導入する際のツール選定のポイントを紹介します。

「いろいろなETLツールがあるが、どのタイプのETLツールを選べばいいかわからない」という方は、ぜひ参考にしてみてください。

どのタイプのETLツールを使うかを決める

ETLツールは大きく分けて3つの種類に分けることができます。

下記は3つのETLのツールの種類と代表的なツールを解説していますので、ETLツールの参考にしてみてください。

クラウドETLツール:TROCCO

クラウドETLツールとは、SaaS型で提供されるETLツールです。

特徴として、ノーコードまたはローコードで利用でき、データ連携の設定が簡単です。

インフラ構築が不要でGUI操作中心で導入できる点が大きなメリットです。

クラウドETLツールとしては、日本企業向けに最適化された「TROCCO」が代表的といえます。

クラウドETLツールを使う際は、どの程度のテータ転送量やユーザー数で使用するかを検討しておきましょう。

その理由は、データ転送量やユーザー数が増えることで、コストが膨らむ可能性があるためです。

この点をしっかりと検討しておけば、クラウドETLツールのコスト問題に悩む可能性は低くなります。

こんにちは、DX攻略部のkanoです。 TROCCOはデータ基盤の総合支援サービスとして注目を集めているツールです。 しかし、私のような非エンジニアでもデータ転送や連携は難しくないのか気になっていました。 そのため、最初に[…]

オープンソース:Apache AirflowやApache Nifi

オープンソースETLツールは、自社サーバーやクラウド上にインストールして使うタイプです。

ソースコードが公開されているため、自由度が高いのがメリットになります。

コミュニティ版であればライセンス費用が不要なものが多く、コードやプラグインをカスタマイズできるため、複雑なワークフローやリアルタイム処理に対応しやすいです。

大規模データ処理なら、Apache AirflowやApache Nifiなどが存在します。

ただし、オープンソースETLを導入する場合はインフラ構築などが必要で、エンジニアリングリソースが欠かせない点に注意しましょう。

他のタイプと比較すると、障害対応やバージョンアップなどに絡んで、運用コストがかかりやすい点も課題です。

プログラムベース:Python、dbt、SQLなど

プログラムベースのETLは、自由度が高く、独自のデータ処理フローを構築できる点が特徴です。

「Python」や「Scala」、「SQL」などでスクリプトを自作し、ETLフローを構築する形になります。

また、「dbt」や「Spark」のようにデータ変換をおこなうプログラム制御も必要です。

プログラムベースのETLツールを使うことでライセンスコストが不要になり、既存のプログラム資産やライブラリを活用しやすくなります。

自由度が高く、高度な分析処理を組み込みやすい点もメリットといえるでしょう。

ただし、すべてをコードで書く必要があり、開発・保守の工数が大きく、特定のエンジニアに依存しやすい点に注意してください。

自由度が高いというメリットと全てをコードで書く必要があるという点で、メリットとデメリットをうまく把握しておくことが求められます。

こんにちは、DX攻略部のkanoです。 データを扱う業務において、ETLという言葉が頻繁に登場します。 「ETLって言葉、わかってるふりをしてるけど実はわかってない…」という方はいらっしゃいませんか? 非エンジニアである私[…]

導入プロセスに気をつける

ツール選定時には導入プロセスも事前に考えておきましょう。

たとえば、現状フローの洗い出しをおこない、データソースの一覧化や流れを図式化しておくと導入ツールの検証がしやすくなります。

また、自社のエンジニアのリソースの確認や、どのデータソースを優先的にETLツールで扱うかなどの、要件整理も必要です。

現状分析と要件整理をおこなうことで、ETLツール選定時に自社に合ったものを選べるようになります。

初めてETLツールを導入する際は、小規模データや特定のワークフローに限定するという方法もおすすめです。

同時に社内チームの体制づくりやスキルアップをおこなえば、導入したETLツールで業務効率化が実現できる環境が整います。

せっかく導入したETLツールが無駄になってしまうと、むしろ現状よりもコストがかかる状態になってしまうのです。

そうならないためにも、ETLツールの導入プロセスに気をつけてスムーズかつ着実な導入を実現させましょう。

まとめ

ETLツールを活用することで得られるコスト削減や効率化について解説しました。

ETLツールを導入し、データ処理を最適化することは、コスト削減と効率化につながります。

高品質なデータをタイムリーに確保できるため、組織の意思決定を加速させられる点も大きなメリットです。

今後もデータの重要性は増していく一方なので、ETLツールを起点としてデータ処理のコスト削減と効率化を実現し、さらなるデータ活用につなげましょう!

DX攻略部では、企業のコスト削減や効率化につながるDX化に関するご相談を受け付けておりますので、ぜひお問い合わせください。