こんにちは、DX攻略部のkanoです。

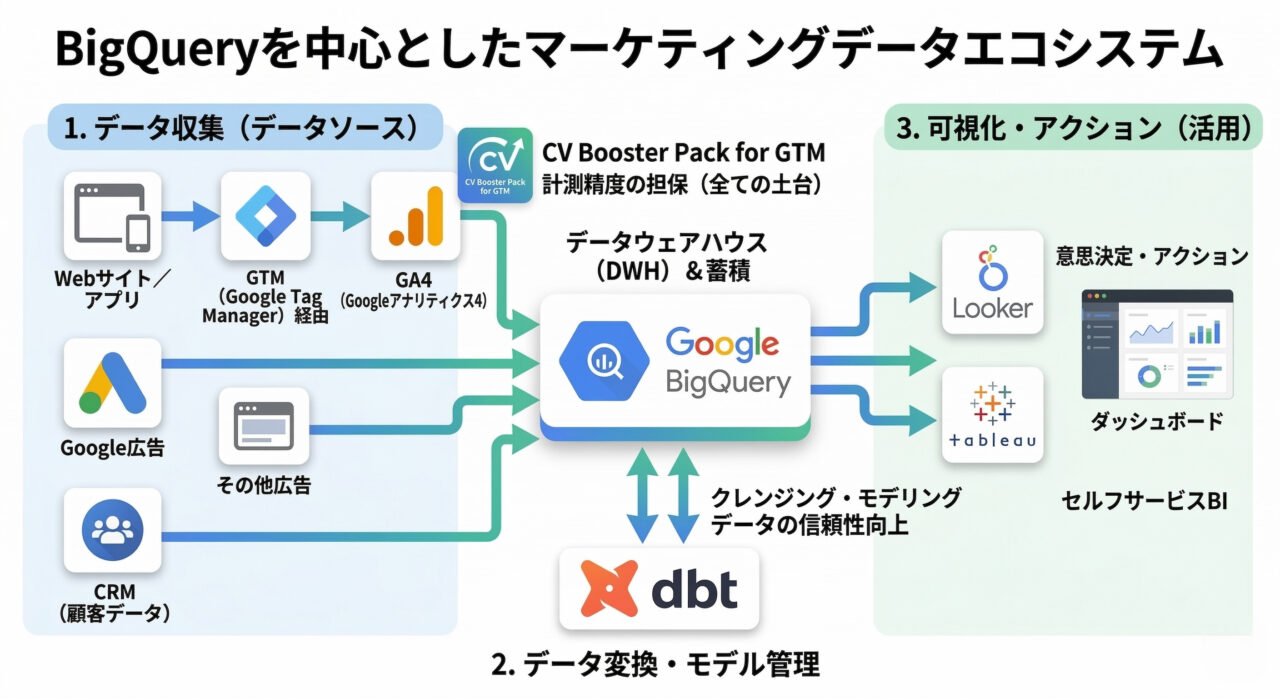

Googleが提供する超高速データウェアハウスであるBigQueryは、今やデジタルマーケティングの成否を分ける心臓部と言っても過言ではありません。

GA4の生データを蓄積し、CRMや広告データと統合することで、標準レポートでは不可能な高度な分析が可能になります。

本記事では、BigQueryの基本概念から、マーケティング実務で役立つ具体的な活用法、コストを抑える運用のコツまでを網羅的に解説します。

エンジニアではないマーケターの方でも、データ活用の全体像を理解し、明日からの実務に活かせる実践的な内容となっています。

なお、DX攻略部では、高度なBigQuery分析やBI可視化の前提となる「正確なデータ計測環境」を、インポートのみで即座に構築できる『CV Booster Pack for GTM』を提供しています。

土台となるデータ精度にこだわりつつ、BigQueryへのエクスポート後の加工工数を最小限に抑えたい方は、ぜひこちらもご活用ください。

【基礎編】BigQueryとは?マーケターが知っておくべき次世代データ基盤の定義

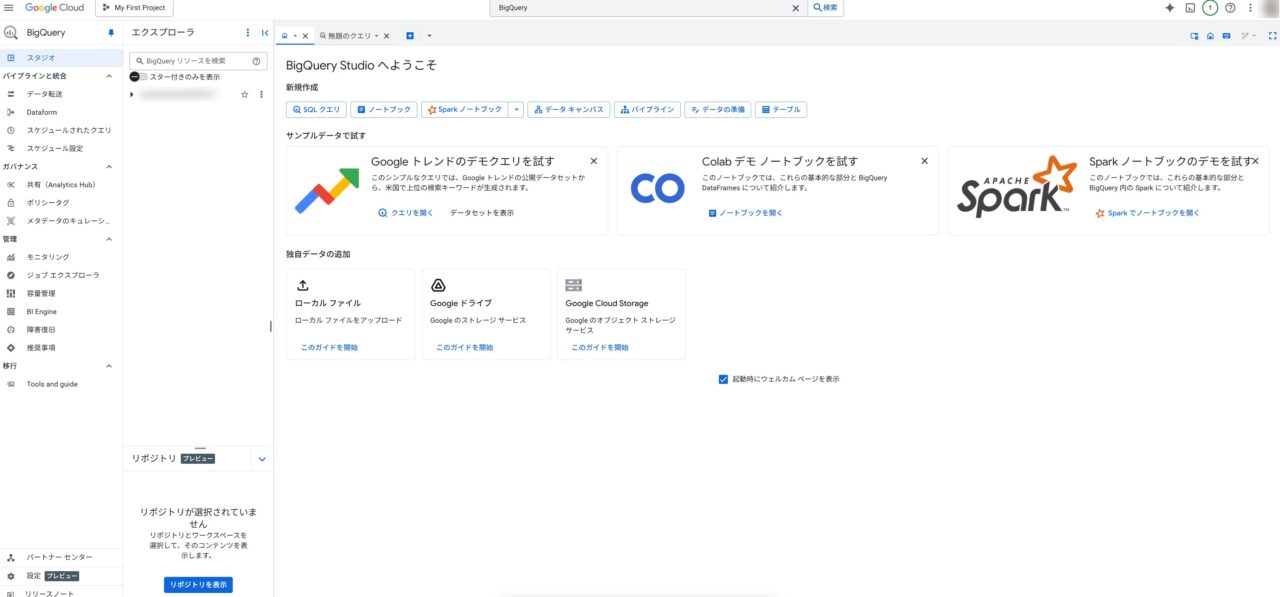

BigQueryは、Google Cloud Platform(GCP)が提供する、エンタープライズ向けのデータウェアハウス(DWH)です。

テラバイト、ペタバイト級の膨大なデータに対して、数秒から数十秒でクエリ(検索処理)を実行できる圧倒的なスピードが最大の特徴です。

なぜこれほどまでに注目されているのか、その基礎を紐解きます。

クラウドデータウェアハウスの定義

BigQueryはGoogle Cloudが提供するクラウドデータウェアハウスで、膨大なデータを高速に分析できる点が大きな特徴です。

サーバーの構築やチューニングが不要で、データをアップロードすればすぐにクエリ実行を開始できます。

なぜ今、マーケティングにBigQueryが必要なのか?

現在のデジタルマーケティングでは、GA4のデータだけでは不十分なケースが増えています。

広告プラットフォームのデータ、顧客管理システム(CRM)の成約データ、そしてWebサイト上の行動履歴、これらを一つの場所に集約し、統合的に分析するための受け皿としてBigQueryが最適だからです。

データのサイロ化を防ぎ、真の顧客理解を深めることが、DX推進の第一歩となります。

サーバーレスがもたらす「運用のタイパ」と圧倒的なスケーラビリティ

BigQueryの大きな利点はサーバーレスであることです。

従来のようなデータベースサーバーの立ち上げや、ストレージ容量の管理、パフォーマンス向上のためのインフラ調整は一切不要です。

Googleが裏側でリソースを自動調整してくれるため、マーケターはインフラ管理に時間を取られることなく、分析そのものに集中できます。

このタイパの良さが、実務現場での導入を後押ししています。

データウェアハウス(DWH)としての立ち位置と役割

BigQueryは、単にデータを保存するだけのストレージではありません。

分析のために最適化されたデータの倉庫(ウェアハウス)です。

Excelやスプレッドシートではフリーズしてしまうような数百万行のデータも、BigQueryなら一瞬で処理可能です。

過去の履歴データをすべて蓄積し、必要な時に必要な形に取り出せる基盤としての役割を担います。

こんにちは、DX攻略部のkanoです。 クラウドDWH(データウェアハウス)やSnowflakeという名前は聞くものの、以下のような悩みや疑問をお持ちではないでしょうか。 「本当に投資する価値があるのか」 「社内のどのシス[…]

【価値編】BigQuery導入がビジネスにもたらす3つの決定的メリット

BigQueryを導入することで、これまでの分析業務はどのように変わるのでしょうか。

数あるデータ基盤の中でも、特にマーケティング領域においてBigQueryが選ばれる理由を、3つの決定的メリットに絞って解説します。

特徴1:膨大なデータを数秒で処理する高速性と自動スケーリング

BigQueryのクエリ速度は驚異的です。

カラム型ストレージという特殊な保存形式と、Googleの強力な並列分散処理技術により、スキャンするデータ量がどれだけ増えても高速なレスポンスを維持します。

データ量が増えるたびにシステムの増設を心配する必要がないため、長期的なデータ蓄積に最適です。

初期費用ゼロ・従量課金モデルによる圧倒的なコストパフォーマンス

高額なライセンス費用は必要ありません。

使った分だけ支払う従量課金制であり、毎月の無料枠も充実しています。

スモールスタートが可能でありながら、ビジネスの成長に合わせて柔軟に拡張できるため、コストパフォーマンスに優れた運用が可能です。

Googleエコシステム(GA4/Google広告)とのシームレスな統合

GA4との公式連携機能により、クリック一つで生データのエクスポートが始まります。

また、Google広告のデータを自動で取り込む機能もあり、Googleの各種ツールとの親和性は他のツールを圧倒しています。

広告とWeb行動を紐付けたLTV分析などが容易に実現できるのは、BigQueryならではの強みです。

こんにちは、DX攻略部のkanoです。 GA4を導入すると、さまざまなデータを確認できるようになります。 しかし、GA4のデータを解析するうえで以下のような疑問を持ったことはありませんか?」 「GA4のデータにクエリってあ[…]

【設計編】データ分析を効率化するテーブル構造と取り込み手法

データをBigQueryに入れただけでは、効率的な分析はできません。

後々の運用コストやクエリの書きやすさを左右するのが、取り込み時の設計です。保守性の高いデータ基盤を作るためのポイントをまとめました。

データセットとテーブル設計のベストプラクティス

BigQueryはプロジェクト、データセット、テーブルという階層構造でデータを管理します。

分析の目的ごとにデータセットを分け、テーブル名には日付やカテゴリを含めるなど、誰が見ても中身がわかる命名規則を徹底することが、チームでの活用を円滑にするコツです。

ファイル取り込み(CSV/JSON/Parquet)

Cloud Storageに保存したCSVやJSONファイルは、BigQueryのウェブ画面やCLIで数ステップ操作するだけで取り込めます。

Parquet形式を使うとファイルサイズを小さくでき、読み込みもさらに速くなります。

バッチロードとストリーミング挿入の賢い使い分け

1日1回まとめてデータを入れるバッチロードは、取り込み費用が無料というメリットがあります。

一方で、リアルタイムな数値確認が必要な場合は、即時にデータを反映させるストリーミング挿入を選びます。

用途に合わせてこれらを使い分けることが、コスト最適化の鍵となります

分析効率を左右する「上流データ(GTM設定)」の品質管理

BigQueryに格納されるデータの品質は、その前段であるGTM(Googleタグマネージャー)の設定に依存します。

GTMでのイベント設計がバラバラだと、BigQuery側で複雑なSQLを書いてデータを整形しなければならず、クエリコストも増大します。

上流の計測環境をCV Booster Pack for GTMなどで標準化しておけば、BigQuery内のデータも整理された状態で蓄積されるため、分析のタイパが劇的に向上します。

▶︎ CV Booster Pack for GTMの詳細を見てみる

こんにちは、DX攻略部のkanoです。 Snowflake Cortexは、社内データをSnowflakeに置いたまま、要約や分類、検索、文書の読み取りなどの生成AI活用を進められる仕組みです。 とはいえ、最初に迷うのは『どの機[…]

【実践編】コストを抑えつつ高速レスポンスを実現するクエリ最適化

BigQueryはクエリでスキャンしたデータ量に応じて課金されます。

何も考えずにSELECTを実行してしまうと、意図しない高額請求が発生する恐れがあります。

コストを抑えつつ、常に高速なレスポンスを得るための実践的なテクニックを紹介します。

パーティショニングとクラスタリングによる課金抑制

日付ごとにデータを区切るパーティショニングや、特定の列でデータを並べ替えて保存するクラスタリングは、クエリ実行時にスキャンする範囲を最小限に抑える効果があります。

これにより、処理速度が上がるだけでなく、課金対象となるデータ量を大幅に減らすことができます。

マテリアライズドビューを活用した定型クエリの高速化

頻繁に実行する集計クエリは、マテリアライズドビュー(実体化されたビュー)として定義しておくと、計算結果が事前に保存されるため、毎回ゼロから計算する必要がなくなります。

ダッシュボードの表示速度を上げたい場合に非常に有効な手法です。

コストを抑えるクエリ最適化手法

不要な列の選択を避けたり、サブクエリではなくJOIN句を使ったりすることで、スキャンデータ量を減らしてコストを抑えられます。

JOIN句は、別々のテーブルに分かれている関連データを「結びつけて」一度に取り出すための命令です。

たとえば「顧客テーブル」と「注文テーブル」を結合すれば、各顧客がどんな注文をしたかをまとめて把握できます。

クエリをシンプルにするための「前処理」の重要性

GA4の生データは、ネストされた複雑な構造をしています。

分析のたびにその複雑なデータを加工するSQLを書くのは非効率です。

あらかじめ分析しやすい形に整形(前処理)したテーブルを作っておくことで、日々の分析業務をスムーズに進めることができます。

こんにちは、DX攻略部のkanoです。 ウェブサイトやアプリのユーザー行動を正確に把握し、マーケティング施策やプロダクト改善に役立てるために欠かせないのがGA4の「イベント」です。 本記事では、GA4 におけるイベント計測の基礎[…]

【GA4連携編】生データをマーケティング武器に変えるエクスポート設定

GA4とBigQueryを連携させることで、GA4の管理画面上のレポート制限(データの保持期間やしきい値の適用)から解放されます。

ここでは、連携の具体的な手順と、生データを扱う際の注意点を解説します。

GA4からBigQueryへのエクスポート設定と注意点

GA4の管理画面からBigQueryエクスポートを有効化すると、日次またはストリーミング形式でイベントデータが自動的にBigQueryに送られます。

- GA4管理画面にログインする

- BigQueryリンクを作成する

- プロジェクトとデータセットを選ぶ

- エクスポート形式を決める

- 権限を承認する

- 動作を確認する

設定はGA4の管理画面から数クリックで完了しますが、毎日エクスポートされるデータの容量には注意が必要です。

無料枠を超えそうな場合は、必要なイベントのみに絞って転送するなどの調整が必要になることもあります。

GA4イベントパラメータのスキーマ設計

イベントパラメータはJSON形式で格納されるため、必要なキーと値を抽出するSQLビューを作成しておくと、後の分析がスムーズになります。

「必要なパラメータを絞り込む」、「キーと値の型を定義する」、「命名ルールを決める」といった運用にすることをおすすめします。

ビュー作成によるデータ構造の整備

頻繁に使うイベント情報をカラム化したビューを用意することで、毎回複雑なJSON操作をせずに分析を始められます。

ビューを1度整備しておくことで、人間が読みやすい表形式データを得られるようになるのです。

こんにちは、DX攻略部のkanoです。 近年、ウェブ解析ツールの代表格であるGoogle Analyticsの最新バージョン「GA4(Google Analytics 4)」が大きな注目を集めています。 従来のユニバーサルアナリ[…]

【活用編】現場の改善を加速させる具体的なGA4データ分析手法

BigQueryに溜まったデータを、具体的にどうビジネスに活かすべきか。実務でよく使われる3つの分析パターンを紹介します。

ユーザー行動のセグメント抽出によるターゲットの精緻化

GA4の生データを活用すれば、特定の商品を3回以上閲覧し、かつカートに追加したが購入していないユーザー、といった非常に細かいセグメントを抽出できます。

これをGoogle広告に再連携することで、より精度の高いターゲティングが可能になります。

例えば「add_to_cart」、「purchase」の発生回数や有無をユーザーごとにまとめた情報を得ることで、迷っている層へのピンポイントな広告配信が実現できます。

こんにちは、DX攻略部のkanoです。 広告運用において、タグ設定のスピードと正確さは成果を左右する生命線です。 GTMを活用して広告タグを一元管理できれば、開発工数を削減し、データに基づいた迅速な意思決定が可能になります。 しかし、[…]

正確なイベント計測に基づくコンバージョンファネル可視化

フォームの各ステップでの離脱率を正確に把握するには、詳細なイベント計測が不可欠です。

BigQuery上でファネルを可視化することで、サイト内のどこにボトルネックがあるのかを明確にし、具体的な改善アクションにつなげることができます。

リマーケティングリスト作成のワークフロー

購入見込みが高いユーザーを抽出して専用リストにまとめるSQLを実行し、その結果を広告プラットフォームにインポートすると、効率的にリマーケティング施策を実施できます。

こんにちは、DX攻略部のmukkukoです。 今回は、GA4の探索レポートの使い方についてご紹介します。 GA4のレポート機能を活用する中で、「もっと深掘りしたデータが取りたい」「そもそもレポート機能はどういう仕組みなんだろう」[…]

BI/ETL連携による分析環境構築

BigQueryはさまざまなBIツールやETLツールと連携が可能です。

そういったツールと連携する方法について説明します。

Looker/Tableau/Power BIとの接続設定

各BIツールはBigQueryのネイティブコネクタを提供しており、認証情報を設定するだけでテーブルを読み込めます。

認証情報を用意した後、BIツール側でコネクタを設定すればOKです。

そして、読み込んだテーブルやビューをキャンパスに配置し、グラフやクロス集計を直感的に組み合わせてレポートを完成させれば完成します。

TROCCO/Fivetran/StitchによるETLパイプライン構築

GA4以外の広告配信データやCRMデータも含めてBigQueryに集約するには、TROCCO、Fivetran、StitchといったETLサービスを使うと手間を大幅に省けます。

GA4以外の広告配信データやCRMデータも同じBigQueryに集約したい場合は、TROCCO、FivetranやStitchで定期的に外部データを同期します。

こんにちは、DX攻略部のkanoです。 デジタル変革(DX)に成功している企業は、データを“集める・整える・届ける”プロセスを高速かつ確実に回しています。 その基盤の役割を担うのが primeNumber 社のETL/データオペ[…]

データフロー自動化のためのCloud Composer活用

Cloud Composer(Apache Airflow)を使うと、BigQueryへのロードやDB間のデータ移動、レポート生成などのワークフローをコードで定義して自動実行できます。

こんにちは、DX攻略部のkanoです。 日々の業務の中で、膨大なデータを取り扱うことはコストや時間がかかります。 そういった問題を解決するためにおすすめなのが「ETLツール」というツールです。 ETLツールを活用することで[…]

【運用編】持続可能なデータ活用を支えるセキュリティとガバナンス

BigQueryの運用管理とガバナンスについて紹介します。

BigQueryは便利なツールですが、適切な運用管理やデータを安全かつ正しく扱うための「決まりごと」と「仕組み」の設定が重要です。

その点を踏まえて、運用管理とガバナンスについて確認しましょう。

課金アラート設定とクエリコスト監視

Google Cloudの予算アラート機能を使って、月間クエリ費用が一定額を超えたら通知する設定ができます。

Google系のツールを使う際は、「Cloud Billing」を使って、Google Cloudのすべての料金を1箇所でモニタリングして、想定外の請求が発生する事態を避けましょう。

IAM設計による最小権限のアクセス制御

BigQueryやBIツールには細かいロール設定があり、分析担当者と運用担当者で必要最低限の権限を割り当てることでセキュリティを強化できます。

最小限の権限を厳格に管理することで、データ漏えいや誤操作リスクを低減できます。

監査ログとデータ品質チェックの仕組み

Cloud Audit Logsで誰がいつどのテーブルを操作したかを記録し、定期バッチでレコード数やスキーマ変更をチェックすると、不正利用や意図しない変更を早期に発見できます。

監査ログと品質チェックを自動化しつつ、人の目でも定期的にレビューすることで、データの正確性と安全性を継続的に担保できるようにしましょう。

まとめ

BigQueryはクラウドならではのスケーラビリティとサーバーレス運用により、初心者でも手軽に大規模データ分析を始められます。

GA4と組み合わせることで、Webサイトやアプリの行動データを柔軟に分析し、BIツールやETLと連携して組織全体のデータ活用力を高めることができます。

まずは小さなデータセットで試験的にクエリを実行し、徐々に運用フローを整備しながらステップアップしてください。これにより、データドリブン文化の定着を加速できます。

まずは、基盤となるGA4とGTMの計測環境を見直すことから始めてください。

自社での構築に時間をかけすぎず、『CV Booster Pack for GTM』のようなツールを賢く活用することで、最短ルートで高度なデータ分析環境を手に入れることができます。

データドリブンな意思決定を加速させ、競合に差をつけるマーケティングを実現していきましょう。

DX攻略部では、各企業様に合わせたマーケティング施策のご相談を受け付けていますので、ぜひDX攻略部にご相談ください!