こんにちは、DX攻略部のkanoです。

多くの企業でGA4の導入が進みましたが、そのデータを単なるサイト計測で終わらせてはいませんか。

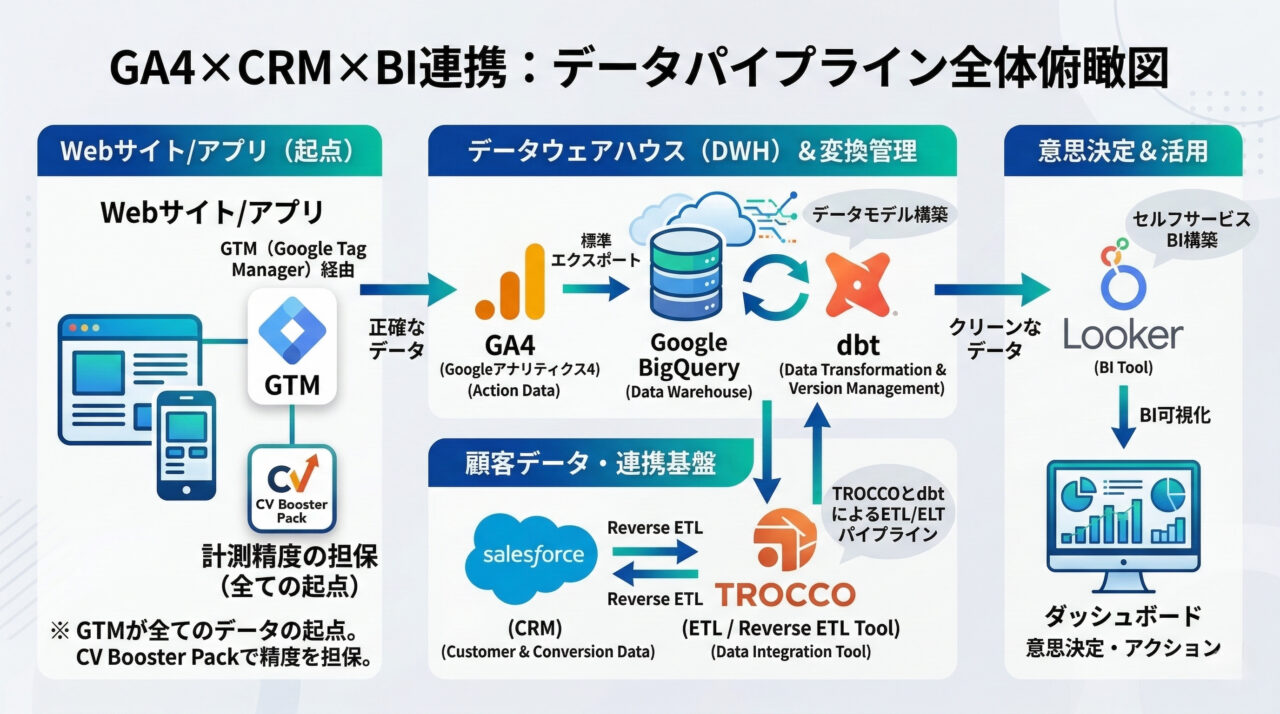

真のデータ活用とは、GA4の行動データとCRMの成約データを統合し、ビジネスの意思決定を支える生きた情報に変えるプロセスを指します。

本記事では、実務でのタイパ(タイムパフォーマンス)を重視し、TROCCOやdbtを活用して効率的かつ高精度なデータパイプラインを構築する具体的な手法を解説します。

ツールを繋ぐこと自体を目的とせず、最短距離で現場が動く分析環境を作るための実践ガイドとして、ぜひ本内容を役立ててください。

なお、DX攻略部では、高度なCRM連携やBI可視化の前提となる「正確なデータ計測環境」を、インポートのみで即座に構築できる『CV Booster Pack for GTM』を提供しています。

土台となるデータ精度にこだわりつつ、実装工数を最小限に抑えたい方は、ぜひこちらもご活用ください。

【戦略編】GA4×CRM×BI連携が企業のDXを加速させる理由と具体価値

単なるアクセス解析の枠を超え、GA4のデータをCRM(顧客管理システム)やBI(ビジネスインテリジェンス)と連携させることは、現代のDX戦略において不可欠なプロセスです。

オンライン上の行動データとオフラインの成約データを紐付けることで、初めて真の投資対効果(ROI)が見えてきます。

この章では、データ統合がビジネスにもたらす本質的な価値と、見落とされがちなデータ精度の重要性について解説します。

なぜ「GA4単体」の分析では不十分なのか?

GA4は非常に強力なツールですが、Webサイトやアプリ内での行動を捉えることに特化しています。

しかし、B2B企業であれば商談の進捗、Eコマースであればリピート購入や返品といった、Webサイトの外側で起きている重要なイベントを把握することはできません。

GA4単体での分析に終始してしまうと、広告で集客したユーザーが最終的にどれだけ利益に貢献したかというLTV(顧客生涯価値)の視点が欠落してしまいます。

これが、多くの企業がデータ活用で足踏みしてしまう要因の一つです。

こんにちは、DX攻略部のkanoです。 近年、ウェブ解析ツールの代表格であるGoogle Analyticsの最新バージョン「GA4(Google Analytics 4)」が大きな注目を集めています。 従来のユニバーサルアナリ[…]

データ統合(GA4×CRM)がもたらす顧客理解の深化

GA4のユーザー識別子とCRMの顧客IDを連携させることで、ユーザーの動きを一気通貫で可視化できるようになります。

-

初回接触:どの広告から流入したか

-

検討フェーズ:どの記事を読み、どの資料をダウンロードしたか

-

成約フェーズ:いつ、いくらで受注に至ったか

-

継続フェーズ:導入後の活用状況やアップセル、解約リスク

これらが一つのダッシュボードでつながることで、マーケティング担当者は質の高いリードを連れてくる施策を正確に判断できるようになります。

こんにちは、DX攻略部のくろさきです。 近年、ビジネスの現場では「データドリブン」という言葉が頻繁に使われるようになりました。 これは、経験や勘だけでなく、収集したデータをもとに意思決定を行う手法を指します。 従来の直感に[…]

思決定のスピードを上げるデータドリブンな組織への転換点

データが統合されBIで可視化されると、報告のための集計作業という非生産的な時間が削減されます。

現場の担当者が自ら必要なデータを引き出せる環境(セルフサービスBI)を構築することで、仮説検証のサイクルが劇的に早まります。

スピード感が求められる現在のビジネス環境において、このタイパ(タイムパフォーマンス)の向上こそがDXの真髄と言えます。

【重要】分析の成否を分ける「入り口のデータ精度」

どれだけ高度な分析基盤を構築しても、入り口となるGA4の計測設定が不正確であれば、得られる洞察はすべて誤ったものになります。

特にGTM(Googleタグマネージャー)でのイベント設定は、手動で行うとミスが起きやすく、メンテナンスコストも膨大です。

そこで検討したいのが、あらかじめ最適化された設定ファイルをインポートする手法です。

CV Booster Pack for GTMを活用すれば、実務で必要な計測設定を短時間で、かつ高い精度で完了させることができます。

基盤構築の工数を削減し、本来の目的である分析にリソースを集中させることが、プロジェクト成功の近道です。

▶︎ CV Booster Pack for GTMの詳細を見てみる

【実装:パイプライン編】TROCCOによるGA4とSalesforceの高度なデータ連携

データ連携の肝となるのは、異なるシステム間でデータをスムーズに、かつ安定して移動させるパイプラインの構築です。

エンジニアによるスクラッチ開発は柔軟性が高い一方で、保守コストや属人化のリスクを伴います。

ここでは、データ転送ツールであるTROCCOを活用し、GA4、BigQuery、Salesforceを効率的に繋ぐ実装フローについて詳述します。

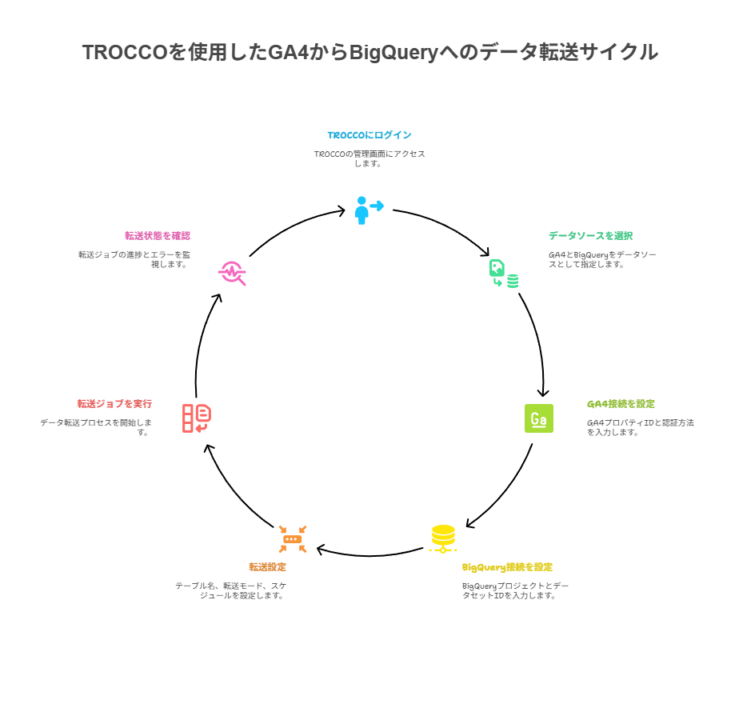

TROCCOを活用したGA4→BigQueryの自動パイプライン構築

GA4からBigQueryへの標準エクスポート機能は便利ですが、データのクリーニングや加工が必要なケースが多々あります。

TROCCOは、さまざまなデータソースからデータを収集し、クラウド上のデータ倉庫(Data Warehouse:DWH)へ定期的に自動取り込みするツールです。

TROCCOを介在させることで、BigQueryに格納する前に不要なパラメータを除去したり、特定の条件でデータをフィルタリングしたりといった前処理をGUI上で完結できます。

最初にGA4で収集した「ユーザー行動ログ」をBigQuery(Googleのデータ倉庫サービス)にまとめる仕組みを構築しましょう。

TROCCOは非エンジニアでも簡単にデータを扱う流れを構築できるので、画面の指示に従って勧めばOKです。

今回の場合であれば、TROCCOの管理画面でGA4のアカウント情報を設定し、「データ転送」で転送元にGoogle Analytics 4、転送先にGoogle BigQueryを選びます。

今回の場合であれば、TROCCOの管理画面でGA4のアカウント情報を設定し、「データ転送」で転送元にGoogle Analytics 4、転送先にGoogle BigQueryを選びます。

その後は、GA4やBigQueryの接続情報を登録し、必要な情報を定義すれば、以降はノーコードでデータが更新され続けます。

こんにちは、DX攻略部のkanoです。 「定期的にデータ転送する必要があるが、手動でおこなうのは手間だし、忘れてしまう」ということがありませんか? 今回はETLツールとして注目を集めているTROCCOを使えば、その悩みが解消でき[…]

BigQueryからSalesforceへのReverse ETL設計

Reverse ETLとは、データ倉庫に溜まった分析用データを、Salesforceなどの業務システムに送り返す仕組みです。

TROCCO上で、BigQuery上の特定ビュー(分析用のまとめデータ)をSalesforceコネクタの設定で、同期先のカスタムオブジェクトを選択します。

この設定を行うことで、営業リストや顧客スコアなどを最新の状態でCRMに反映できます。

Reverse ETLを導入すると、分析チームが作った高度な指標を営業現場がリアルタイムに活用できるようになり、マーケ・営業・CS(カスタマーサクセス) の連携がスムーズになります。

また、ノーコード転送に置き換えることで、人為ミスと工数を削減でき、Single Source of Truthで計算した値を直接書き戻すため、数字が一貫するのもポイントです。

Single Source of Truthについては、下記の記事で詳しく解説していますのでぜひ参考にしてみてください。

こんにちは、DX攻略部のくろさきです。 経営会議の場で、営業部が出してきた売上数字と、経理部が出してきた入金データが一致しない、このような経験はないでしょうか。 現代のビジネス環境では、情報が部門ごとに分散し、データの不一致や更[…]

実装時にハマりやすいポイントと回避策

データ連携の実装において最も多いトラブルは、データ型の不一致やAPIの制限による転送エラーです。

特にGA4のイベントパラメータは自由度が高いため、事前の設計書が不十分だとBigQuery側でエラーが多発します。

-

各項目のデータ型(文字列、数値、日付)を厳密に定義する

-

更新頻度と転送ボリュームを事前に試算する

-

エラー発生時の通知フローを確立し、即座に対応できる体制を整える

これらを設計段階で固めておくことが、運用後の手戻りを防ぐ最大のポイントです。

最短で正確なデータ基盤を作るための「GTM設計」の勘所

データ連携の効率を最大化するには、上流工程であるGTMの設計を標準化することが近道です。

各イベントのパラメータ名や計測タイミングが統一されていないと、TROCCOでのマッピングやBigQueryでの加工工数が倍増してしまいます。

自社でゼロから設計書を作成する手間を省き、かつプロ水準の計測精度を確保したい場合は、CV Booster Pack for GTMの導入が有効です。

これにより、データパイプラインの入り口を最短最速で整えることが可能になります。

▶︎ CV Booster Pack for GTMの詳細を見てみる

【実装:DWH編】BigQueryとdbtを駆使したクリーンなデータ基盤の構築

大量のデータを高速に処理する心臓部となるのが、データウェアハウス(DWH)であるBigQueryです。

しかし、ただデータを溜めるだけではデータの墓場になってしまいます。

この章では、データの変換管理ツールであるdbtを組み合わせ、保守性が高く信頼できるデータ基盤を構築するテクニックを紹介します。

BigQueryのパフォーマンスを最大化するデータモデリング

BigQueryはスキャンしたデータ量に応じて課金される仕組みです。

そのため、テーブルを適切に分割(パーティショニング)したり、頻繁に使用する列をクラスタ化したりすることで、クエリ速度の向上とコスト削減の両立を図る必要があります。

特にGA4の生データは、ネストされた構造(RECORD型)になっているため、そのままでは分析時に負荷がかかります。

用途に合わせてフラットなテーブルに変換しておくことが実務上のスタンダードです。

こんにちは、DX攻略部のkanoです。 Googleが提供する超高速データウェアハウスであるBigQueryは、今やデジタルマーケティングの成否を分ける心臓部と言っても過言ではありません。 GA4の生データを蓄積し、CRMや広告データと[…]

dbt導入によるデータ変換の自動化とバージョン管理

dbt(Data Build Tool)は、SQLベースで「生データを分析用モデルに変換・整形」するためのフレームワークです。

データ変換のプロセス(SQL)をコードとして管理できるのがdbtの利点です。

dbtを使ったモデル運用の流れは、下記の3つのポイントを押さえて実行しましょう。

-

変換ロジックのバージョン管理:変更履歴を追跡し、以前の状態に戻すことが可能

-

データ品質のテスト:NULLチェックや重複チェックを自動化し、データの信頼性を担保

-

依存関係の可視化:どのテーブルがどのデータから作られているかを一目で把握

これらをGitリポジトリでバージョン管理し、プルリクエストベースで変更をレビューすると、安全にデータ構造をアップデートできます。

dbtについてさらに詳しく知りたい方は、下記の記事を参考にしてみてください。

こんにちは、DX攻略部のしいです! 2026年のデータ活用において、データの「量」よりも「質」と「鮮度」が問われています。 そのため、企業におけるデータの取り扱いはますます重要になっているわけです。 データを分析・活用する[…]

TROCCOで組むETL/ELTパイプライン例

TROCCOを活用すれば、以下のような流れをワンストップで管理できます。

- GA4からBigQueryへのデータ取り込み(ELT)

- dbtによるモデル変換

- 変換後データの別プロジェクトへのエクスポート(ETL的用途)

GUI上でジョブスケジュールを設定し、失敗時は自動リトライさせることも可能です。

こんにちは、DX攻略部のkanoです。 データを扱う業務において、ETLという言葉が頻繁に登場します。 「ETLって言葉、わかってるふりをしてるけど実はわかってない…」という方はいらっしゃいませんか? 非エンジニアである私[…]

【活用編】Lookerで「現場が動く」セルフサービス分析環境を構築する

GA4のデータを活用してBIの可視化を目指しましょう。

BIは「Business Intelligence(ビジネス・インテリジェンス)」の略です、

企業が持つさまざまなデータ(売上実績、顧客情報、Webアクセスログなど)を集めて整理・分析し、グラフやレポートとして「見える化」し、経営や現場の意思決定を支援する仕組み・考え方を指します。

現場の課題を解決するLookerダッシュボード設計の3原則

Lookerはデータベースに直接接続し、ノーコード/ローコードでダッシュボードを作成できるBIツールです。

ダッシュボードを設計する際は、以下の3点を意識してください。

-

誰が、いつ、何の判断のために見るかを明確にする

-

重要指標(KPI)を最上部に配置し、異常値がすぐわかるようにする

-

数字の背景にあるなぜを探れるよう、ドリルダウン機能を備える

情報量を詰め込みすぎず、アクションに直結する項目に絞ることが、利用率を高める秘訣です。

データ民主化を推進するアクセス権限とセマンティックレイヤー設計

Lookerの最大の特徴は、LookMLという独自の言語でデータの定義を一元管理できる点です。

これにより、ユーザーごとに計算式が異なり、人によって数字がズレるという事態を防げます。

また、役職や部署に応じた適切なアクセス権限を設定することで、セキュリティを保ちながら、必要な人全員にデータを解放するデータの民主化が可能になります。

社内ポータル活用による利用定着施策

ダッシュボードへのリンクをまとめた社内ポータルサイトを用意しましょう。

たとえば、利用頻度の高い情報をトップに配置、新着レポートや注目指標をバナーでお知らせする、といったものです。

また、コメント機能で改善要望をフィードバックといった工夫を取り入れると、自然と社員の「データを参照する」習慣が根付きます。

こんにちは、DX攻略部のkanoです。 GA4やGTMの運用が進んでくると、次に課題となるのが「データの可視化」です。 社内共有や分析のために、わざわざGA4の画面を開いて複雑な操作をするのは手間がかかりますよね。 そんな時に役立つの[…]

【運用編】持続可能なデータ活用を実現するガバナンスと品質管理

データ基盤は作って終わりではありません。

むしろ、運用開始後のデータの汚れや仕様の風化との戦いが本番です。

信頼性の高いデータを維持し続けるためのガバナンス体制と、モニタリングの重要性について解説します。

データカタログによる「データの迷子」を防ぐ管理手法

データカタログは「どのデータがどこにあるか」を整理した辞書です。

この項目は何を意味しているのかが不明確になると、誰もそのデータを使わなくなります。

データカタログを導入し、各項目の定義やデータの出所(リネージ)をドキュメント化しておくことが重要です。

こんにちは、DX攻略部のくろさきです。 現代のビジネス環境では、データの活用が企業の競争力を左右する重要な要素となっています。 しかし、多くの企業では「必要なデータがどこにあるのかわからない」「データの信頼性が不明確」といった課[…]

アクセス制御ポリシーと運用フロー

個人情報や機密情報を含むテーブルは、アクセス権限を厳格に管理する必要があります。

BI/データ倉庫側でロールベースの権限設定や、承認ワークフローを工夫し、申請→承認→付与を自動化するといった対策です。

また、定期的に権限レビューを実施といった運用フローを文書化し、IT部門とビジネス部門が連携して進めましょう。

データの「鮮度」と「精度」を担保するモニタリング体制の作り方

データが届いていない、あるいは異常な数値が記録されているといったトラブルを早期に検知するため、自動モニタリングを組み込みます。

TROCCOやdbtのテスト機能を活用し、異常が発生した際に即座に通知が飛ぶ仕組みを構築しましょう。

こんにちは、DX攻略部のくろさきです。 現代のビジネス環境では、データが企業の競争力を左右する重要な資産となっています。 しかし、データの量と種類が増加する中で、正確性や一貫性を保ち、適切に活用することは容易ではありません。 […]

まとめ

GA4、CRM、BIの連携は非常に強力な武器ですが、構築自体が目的化してはいけません。

大切なのは、得られたデータからどのような仮説を立て、どのようなアクションを起こしてビジネスを成長させるかです。

本記事で紹介した構成をゼロから自前で構築するには、膨大な時間と専門知識を要します。

しかし、DX担当者に求められているのは、基盤を作ることそのものではなく、その先の成果を出すことです。

もし、計測設定やデータ収集のフェーズで躓いているのであれば、外部のテンプレートや支援ツールを賢く活用することを検討してください。

私たちが推奨するのは、最も工数がかかり、かつミスが許されないGTMによる計測設計を効率化することです。

『CV Booster Pack for GTMを』利用すれば、インポートするだけで正確な計測環境が整います。

これにより、本記事で解説したBigQueryやLookerでの高度な分析に、初日から取り組むことが可能になります。。

DX攻略部では、GA4やGTMに関する情報を発信するだけでなく、各企業様に合わせたマーケティング施策のご相談を受け付けています。

GA4やGTMの導入など自社の目的に合わせた設定方法にお悩みの方は、ぜひDX攻略部にご相談ください!